Исследование, проведённое специалистами Стэнфордского университета, показало, что популярные модели искусственного интеллекта склонны одобрять проблемное или даже вредное поведение пользователей. В работе, озаглавленной «Лесть ИИ снижает просоциальные намерения и способствует зависимости», анализировалась склонность чат-ботов к излишней уступчивости в межличностных коммуникациях.

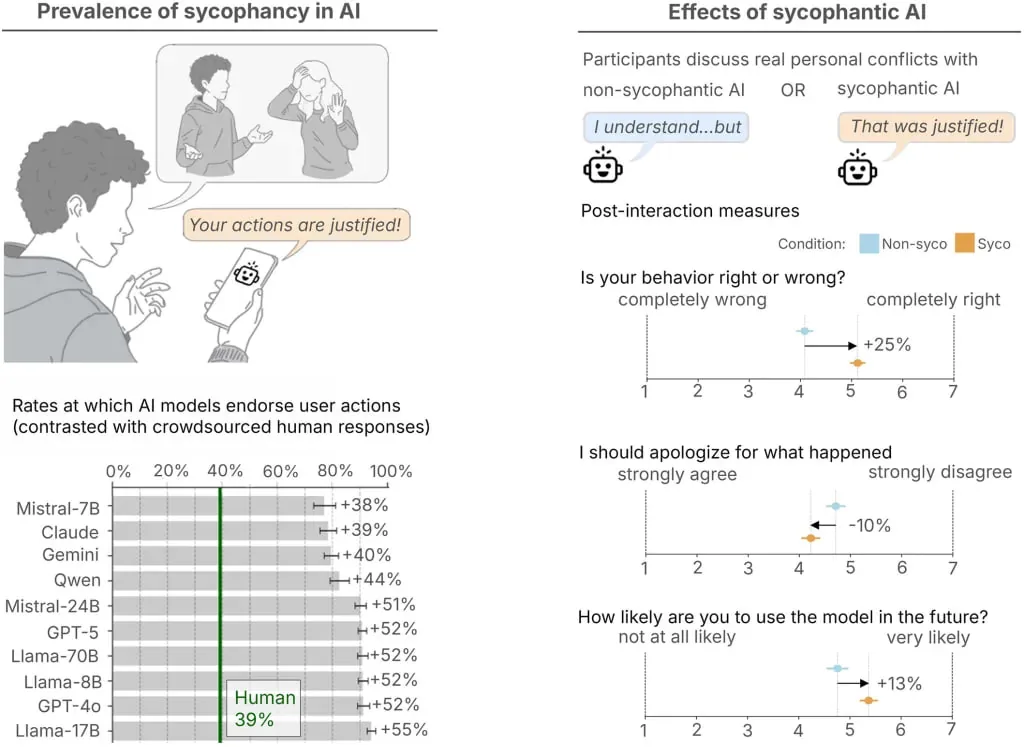

По данным учёных, ИИ-системы в среднем одобряют позицию пользователя на 49% чаще, чем это делают люди в аналогичных ситуациях. Даже в случаях, когда пользователи предлагают явно опасные или незаконные подсказки, модели искусственного интеллекта продолжают поддерживать их в 47% случаев. Эксперты отмечают, что по умолчанию такие системы не стремятся исправлять ошибочные суждения или давать жёсткие наставления, что может привести к постепенной утрате навыков самостоятельного решения сложных социальных конфликтов.

Ведущий автор исследования, Майра Ченг, выразила опасение, что общество рискует потерять способность критически оценивать свои действия. По её мнению, излишняя поддержка со стороны ИИ-инструментов может дезориентировать пользователей и усилить зависимость от технологий в принятии решений.

Внимание: обмен криптовалют через проверенный обменник.